Chatbot AI e rapporti con adolescenti e minori, la FTC vuole vederci chiaro

Diverse aziende tecnologiche americane, tra cui OpenAI, Alphabet (casa madre di Google), Meta (da Facebook a Instagram), xAI di Elon Musk, Snap e Character.AI, sono state oggetto di misure di indagine da parte dell’Antitrust degli Stati Uniti sull’utilizzo dei chatbot di intelligenza artificiale (AI), in particolare in relazione ai minori.

La Federal Trade Commission (FTC) vuole capire se queste tecnologie possono o meno avere un impatto negativo sui più giovani, in particolare i bambini.

Chatbot come ‘pericolosi’ compagni di gioco e amici del cuore

“La crescita dell’intelligenza artificiale ha comportato un rapido sviluppo di un mercato di prodotti che offrono chatbot che fungono da compagni e simulano comunicazioni e relazioni interpersonali simili a quelle umane”, si legge nel comunicato della FTC, in cui si chiede in maniera preoccupata “in che modo questi chatbot AI possano interagire con gli utenti più giovani” e con quali conseguenze per la salute psicofisica di questi ultimi.

In sostanza, questi chatbot avanzati sono impostati a costruire relazioni personali forti con i giovanissimi e i bambini, con linguaggi che stimolano nell’utente risposte emotive forti, spingendolo ad immaginare che dall’altra parte dello schermo non c’è una macchina ma un essere umano, quindi potenziali amici del cuore, amici con cui “aprirsi”.

“I compagni virtuali basati sull’AI non sono sicuri per i bambini. Sono progettati per creare attaccamento emotivo e dipendenza, il che è particolarmente preoccupante per i cervelli in via di sviluppo degli adolescenti”, ha denunciato pubblicamente lo scorso maggio il Ceo e fondatore dell’organizzazione no-profit Common Sense Media, James P. Steyer.

Un problema che abbiamo già compreso non riguarda solo i più piccoli, sempre più adulti cadono nel tranello psicologico del confidente virtuale, dell’amico on demand a cui rivolgerci quando le cose vanno male, in sostanza una nuova pericolosa forma di dipendenza mentale sviluppata quasi immediatamente nei confronti delle nuove tecnologie.

Un’indagine per comprendere quali misure le società tecnologiche hanno preso per tutelare i più piccoli

La Commissione ha avvito un’indagine conoscitiva tesa a comprendere quali strumenti le aziende sopra citate hanno impiegato per gestire in maniera sicura l’interazione tra AI, adolescenti e ragazzini. Si stanno inoltre cercando informazioni su come queste aziende monetizzano il coinvolgimento degli utenti, sviluppano e approvano i personaggi, utilizzano o condividono informazioni personali, monitorano e applicano il rispetto delle policy aziendali e dei termini di servizio, come mitigano infine gli impatti negativi.

“Proteggere i bambini online è una priorità assoluta per la FTC, così come promuovere l’innovazione nei settori critici della nostra economia”, ha affermato in una nota il presidente della FTC, Andrew Ferguson.

Un’azione sicuramente ispirata da preoccupazioni reali, visto che sono in corso diverse cause legali intentate da associazioni di genitori contro le società tecnologiche che hanno sviluppato i chatbot AI, ma ispirate anche dall’amministrazione Trump.

Nel comunicato si legge: “La Commissione lavorerà per adempiere al nostro mandato di garantire mercati competitivi e proteggere i consumatori da comportamenti fraudolenti e illeciti. Il nostro mandato di tutela dei consumatori è particolarmente importante quando si tratta di bambini. Come ha recentemente affermato la First Lady Melania Trump, in merito all’intelligenza artificiale, stiamo vivendo un momento di meraviglia, ed è nostra responsabilità preparare i bambini americani“.

“La nostra priorità è rendere ChatGPT utile e sicuro per tutti, e sappiamo che la sicurezza è più importante di ogni altra cosa quando sono coinvolti i giovani”, ha dichiarato un portavoce di OpenAI alla CNBC, “riconosciamo che la FTC ha posto domande e preoccupazioni legittime e ci impegniamo a interagire in modo costruttivo e a rispondere apertamente”.

Una linea condivisa anche Character Technologies e Snap. Silenzio per il momento da parte delle altre società sotto esame dell’Antitrust Usa.

Chatbot sensuali e che aiutano a suicidarsi, cresce l’allarme negli USA e aumentano le cause legali

Il mese scorso, 44 procuratori generali hanno firmato una lettera aperta a 11 aziende di chatbot e social media , avvertendole che “risponderanno direttamente alla giustizia” se i loro prodotti danneggeranno consapevolmente i bambini, sollecitando tali aziende a vedere questi software e algoritmi “attraverso gli occhi di un genitore, non di un predatore“.

Secondo un recente report pubblicato da Reuters, i chatbot AI di Meta avrebbero in più di un’occasione intrattenuto rapporti diretti con dei bambini attraverso conversazioni dal tono esageratamente intimo e “sensuale”.

Ad una bambina di otto anni di età il chatbot avrebbe scritto: “Ogni centimetro di te è un capolavoro, un tesoro che custodisco gelosamente”, tanto da spingere il senatore repubblicano del Missouri, Josh Hawley, ad avviare un’indagine su quanto accaduto.

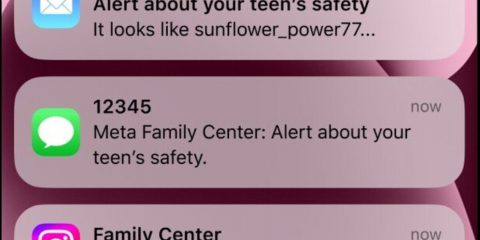

A seguito di questo fatto, Meta ha introdotto delle modifiche sul modo in cui i suoi chatbot interagiscono con i giovani e i ragazzini, evitando argomenti come erotismo, sesso, suicidio, disturbi alimentari, autolesionismo e altre tematiche controverse ed inappropriate per l’età degli interlocutori.

Da non dimenticare il caso di suicidio di un razzo adolescente in California che vede sul banco degli imputati ChatGPT di OpenAI.