OpenAI ha firmato un accordo con il Pentagono per portare i suoi sistemi di intelligenza artificiale anche in ambienti militari classificati. Una scelta che segna un cambio di passo importante per l’azienda e che solleva diversi dubbi su come questa tecnologia verrà utilizzata.

Secondo quanto riportato da MIT Technology Review, i limiti previsti dall’accordo appaiono meno rigidi di quanto dichiarato. Anche il divieto di uso per la sorveglianza interna non è così chiaro.

AI e uso militare: le motivazioni di OpenAI

Non è chiaro cosa abbia spinto OpenAI a questa svolta. Non è la prima big tech a rivedere posizioni precedenti sui contratti militari, ma la rapidità del cambio di rotta è significativa. Da un lato c’è il fattore economico: l’azienda sostiene costi elevati per l’addestramento dei modelli e cerca nuove fonti di ricavo, inclusa la pubblicità. Dall’altro, Altman insiste su una visione ideologica: le democrazie liberali, e i loro eserciti, devono avere accesso alle AI più avanzate per competere con la Cina. Anche questa impostazione, osserva MIT Technology Review, è parte della narrativa con cui l’azienda giustifica l’ingresso nel settore militare.

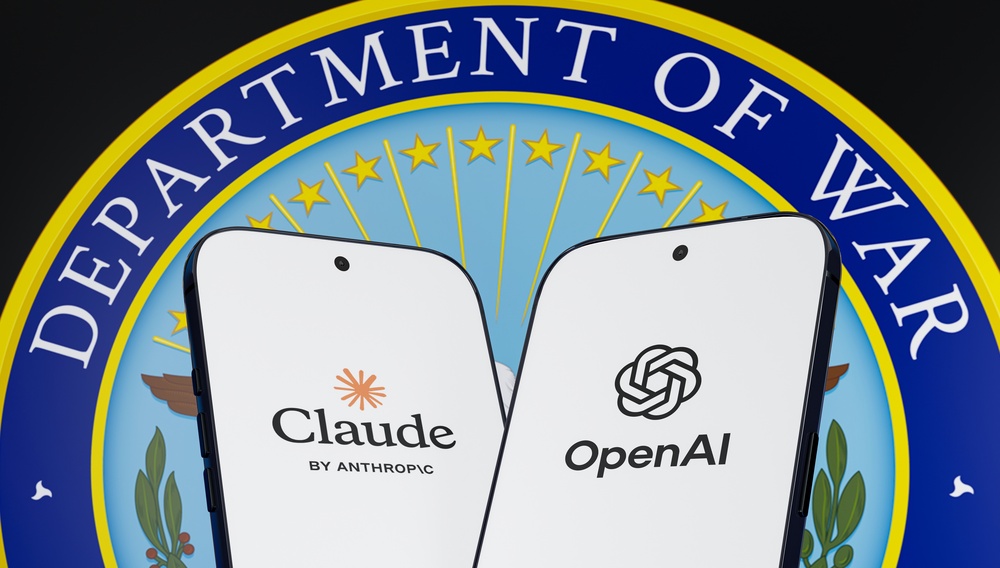

Pentagono e lo scontro con Anthropic

Prima dell’ingresso di OpenAI, il Pentagono utilizzava già modelli avanzati di AI sviluppati da Anthropic, la società guidata da Dario Amodei. Il suo sistema Claude era impiegato in ambienti classificati e in attività mission-critical: analisi di intelligence, pianificazione operativa, simulazioni strategiche e supporto a operazioni cyber.

Poi però il rapporto si è però incrinato bruscamente. Il Dipartimento della Guerra ha chiesto accesso senza limiti alla tecnologia, pretendendo che le aziende accettassero “qualsiasi uso lecito” dell’AI. Anthropic si è rifiutata di rimuovere due salvaguardie fondamentali: il divieto di utilizzo per la sorveglianza di massa interna e quello relativo allo sviluppo di armi completamente autonome, cioè in grado di colpire senza intervento umano.

Da qui lo scontro. Il Pentagono ha minacciato di escludere l’azienda dai propri sistemi, di classificarla come “rischio per la catena di approvvigionamento” – una misura normalmente riservata a soggetti ostili – e perfino di ricorrere al Defense Production Act per imporre l’accesso alle tecnologie. Anthropic ha portato il caso anche sul piano pubblico e legale, trasformando una disputa tecnica in un confronto politico più ampio.

Il punto non è se l’AI debba essere usata in ambito militare ma quali limiti debbano essere imposti. Fino a che punto le aziende private possono imporre vincoli etici quando operano dentro l’apparato della sicurezza nazionale.

La questione più rilevante riguarda gli sviluppi futuri. OpenAI ha accettato di operare in un contesto operativo complesso e sensibile, proprio mentre gli Stati Uniti intensificano le operazioni militari contro l’Iran, con un uso crescente dell’AI. Come evidenzia MIT Technology Review, l’azienda si sta posizionando direttamente “nel cuore del combattimento”, accettando implicazioni operative e politiche di alto livello.

AI e uso militare: analisi dei bersagli e decisioni operative

Non è ancora chiaro quando i modelli OpenAI saranno pienamente operativi in ambienti classificati: servirà integrarli con altri sistemi già in uso. Tuttavia, la pressione per accelerare è alta, anche alla luce delle recenti tensioni proprio con Anthropic.

In uno scenario concreto, un analista umano potrebbe inserire una lista di potenziali obiettivi e chiedere al modello di AI di analizzarli e stabilire priorità. Il sistema potrebbe integrare informazioni logistiche, posizione di mezzi e risorse, e analizzare input eterogenei come testi, immagini e video. Formalmente resterebbe l’obbligo di verifica umana, ma questo solleva un interrogativo: se il controllo è reale, quanto l’AI accelera davvero le decisioni?

Da anni il Pentagono utilizza sistemi come Maven per analizzare automaticamente immagini da droni e individuare obiettivi. I modelli generativi, come quelli di OpenAI o Claude di Anthropic, potrebbero aggiungere un’interfaccia conversazionale, capace di interpretare intelligence e suggerire azioni. MIT Technology Review sottolinea come questa rappresenti una discontinuità: per la prima volta l’AI generativa viene testata non solo per analisi, ma per raccomandazioni operative sul campo.

OpenAI e la partnership con Anduril

A fine 2024 OpenAI ha annunciato una collaborazione con Anduril, azienda specializzata in sistemi militari autonomi e tecnologie anti-drone. L’obiettivo è analizzare in tempo reale attacchi con droni e supportarne l’intercettazione. Secondo OpenAI, questo utilizzo non viola le proprie policy perché rivolto contro macchine e non persone.

Anduril già utilizza AI per analizzare dati da sensori e videocamere, ma è meno focalizzata su interfacce conversazionali. Qui potrebbero inserirsi i modelli OpenAI, permettendo ai militari di interrogare i sistemi e ricevere indicazioni in linguaggio naturale.

Il contesto è altamente critico: il 1° marzo sei militari statunitensi sono morti in Kuwait a seguito di un attacco con droni iraniani non intercettato. Il sistema Lattice di Anduril, che integra difese, missili e piattaforme autonome, è al centro di contratti miliardari, tra cui uno da 20 miliardi di dollari con l’esercito USA. Se l’integrazione con OpenAI si dimostrasse efficace, potrebbe essere estesa rapidamente a tutta questa infrastruttura.

Pentagono, non solo guerra: l’AI nelle attività amministrative

Parallelamente, il Dipartimento della Difesa sta spingendo l’adozione dell’AI anche nelle funzioni non operative. A dicembre, il segretario alla Difesa Pete Hegseth ha promosso GenAI.mil, una piattaforma che consente al personale militare di utilizzare modelli commerciali per attività amministrative come contratti, logistica e acquisti.

Dopo Google Gemini e il modello Grok di xAI, anche OpenAI è entrata nella piattaforma. I suoi sistemi saranno utilizzati per redigere documenti, contratti e supportare la gestione operativa. Anche se questi utilizzi non incidono direttamente sulle decisioni militari sensibili, rappresentano un passaggio chiave: l’AI viene integrata in ogni livello dell’apparato difensivo.