Premessa

Forse qualcuno si ricorderà del film “Anche i bancari hanno un’anima”, un film che ironizza sulla figura dell’impiegato bancario, rassegnato a un lavoro che poco lo soddisfa [1]. Di anni ne sono passati e nel frattempo le banche sono radicalmente cambiate. Sono diventate digitali. Si dice che non saranno più gli impiegati in carne e ossa a farle funzionare ma macchine intelligenti e robot. Sarà così la fine di persone demotivate?

Pare di sì. Infatti, le Digital Bank avranno bisogno prevalentemente di specialisti e di tecnocrati altamente qualificati con funzioni di supervisione di sofisticate strutture tecnologiche. I bancari “sofferenti”, anelanti a un mondo lavorativo più libero e felice, sono, pertanto, destinati all’estinzione.

Le sofferenze cesseranno, si dice, grazie alle macchine intelligenti, capaci di lavorare al posto degli umani senza stress. Saranno gli algoritmi a replicare, anzi a superare, la stessa intelligenza umana. Le macchine intelligenti non creano problemi come gli umani perché non provano sentimenti né empatia.

Già Max Weber aveva preconizzato come le organizzazioni dovessero funzionare, potremmo dire, senz’anima, in modo efficiente grazie alle regole che gli impiegati degli uffici devono seguire in modo rigoroso al fine di fornire prestazioni predefinite, evitando personalismi e soggettivismi. Con la diffusione dell’IA le banche saranno più efficienti e razionali?

Si dice che i computer intelligenti decidono in modo obiettivo ed evitano l’influenza dei sentimenti e i dissensi del personale che questo non sempre condivide le scelte aziendali. Spesso sul piano etico, quando, ad esempio, la banca privilegia il profitto sopra ogni altra considerazione o adotta modelli manageriali poco partecipativi.

Ma può una banca, anche un’impresa, funzionare regolarmente eliminando la “coscienza” delle persone, sostituite dai sistemi di IA?

Banche ridotte a “funzioni di produzione”?

La coscienza è uno spazio semantico interiore dove i segnali provenienti dal mondo fisico, all’interno e all’esterno del corpo, ed elaborati dal cervello, assumono la forma di sentimenti, sensazioni e significati. Le macchine intelligenti non avvertono sentimenti ed empatia perché non hanno e non possono avere una coscienza, per cui non sono capaci di sviluppare in modo consapevole apprendimento e conoscenza della realtà attraverso i qualia che sono appunto le sensazioni, i sentimenti, i pensieri emergenti nella coscienza[2].

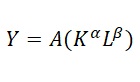

Con la digitalizzazione dei processi, l’organizzazione delle banche tende a fortemente semplificarsi evocando la visione neoclassica di una “funzione di produzione” in cui il fattore tecnologico (K) prevale sul fattore umano (L).

La sua rappresentazione è una funzione matematica (del tipo Cobb e Douglas), dove Y è l’output (i servizi bancari), A un multi-fattore di produttività (connesso al progresso tecnico), K lo stock di capitale tecnologico, L il lavoro (ridotto al minino) e α e β le quote distributive del reddito che vanno ai profitti (massimizzati) e ai salari (minimizzati).

L’elasticità di sostituzione statica di L e K, in una banca ampiamente digitalizzata, è molto alta dato che il lavoro, sia professionale che manageriale, può essere sostituito dalla tecnologia mantenendo costante l’output ma anche aumentandolo.

Con la semplificazione organizzativa, le banche digitali possono perdere le proprie specifiche identità, dipendendo dai fornitori esterni da cui acquistano i sistemi di IA, con un indebolimento delle “coscienze organizzative” in seguito alla marginalizzazione del fattore umano sostituito dal quello tecnologico. Ne possono derivare effetti non solo di indebolimento delle capacità cognitive del personale ma anche di frustrazione in conseguenza di mansioni sempre più operative poco motivanti. Il paradosso è che, per contrastare tali effetti la banca può aumentare il ricorso all’IA con un’ ulteriore riduzione del fattore umano..

Questa tendenza non pare così remota. Basti considerare la situazione di disengagement che si sta riscontrando, soprattutto nei grandi gruppi bancari, in seguito alla massiccia digitalizzazione dei processi e alla verticalizzazione delle decisioni.

Ricerche recenti evidenziano la crescente criticità dei modelli organizzativi partecipativi, al fine della soddisfazione/motivazione al lavoro, i quali rispondono all’esigenza delle persone, soprattutto dei giovami, di svolgere compiti che consentono dare un contributo responsabile all’attività della banca.

Ma con processi decisionali sempre più digitalizzati, in tutti i comparti della banca, le autonomie concesse al personale tendono a comprimersi, aumentando le situazioni di disengagement. Le direzioni bancarie sembrano tollerare queste situazioni nella prospettiva di ulteriori tagli del personale per giungere a modelli bancari quasi totalmente automatizzati.

Verso Digital Bank senza coscienza?

Le macchine intelligenti non hanno la consapevolezza di sé. Per questo gli umani si differenziano dalle macchine intelligenti. L’IA può elaborare simboli, ma non può provare sentimenti e sensazioni. La coscienza crea l’interiorità e permette una connessione autentica con la realtà. Una Digital Bank, funzionante esclusivamente sulla base di sistemi di IA, non avendo nessuna coscienza, non può avere nessuna “vera conoscenza” della realtà perché la coscienza è strumento di conoscenza. Ed è per questo che l’IA non può prevalere sull’intelligenza umana, essendone la coscienza una componente costitutiva.

D’altra parte, va preso atto come lo sviluppo dell’IA possa acuire le situazioni di disengagement del personale, di cui abbiamo detto. Questo viene sempre più esautorato dai processi decisionali automatizzati. Oggi la motivazione a lavorare per un’ impresa evidenzia la rilevanza degli aspetti emozionali del sentirsi partecipi di una coscienza organizzativa comune[3]. E sta assumendo pure rilevanza il concetto di sostenibilità sociale, riferito al modello imprenditoriale, per cui l’orientamento delle banche all’efficienza e alla redditività del capitale non può essere una filosofia unificante sul piano organizzativo.

Con la diffusione dell’IA, vi è il pericolo, quindi, che la banca vada incontro a una deresponsabilizzazione con la perdita di consapevolezza di se stessa. Il rischio peggiore, infatti, è quello di trasformarsi, come ricordato, in una funzione tecnica di produzione. In effetti, questo rischio non è così remoto, vista appunto la situazione di disaffezione che si sta riscontrando soprattutto nei grandi gruppi bancari che verticalizzano le decisioni[4].

Pertanto, la “coscienza” dovrebbe entrare in azione proprio quando vi è il rischio che la tecnologia possa avere il sopravvento sull’organizzazione. Direzioni coscienziose dovrebbero, quindi, adottare modelli organizzativi che integrino il lavoro umano con l’IA e non lo sostituiscano.

La coscienza del banchiere: “sociale” vs “razionale”

I computer manipolano simboli, ma non hanno contenuto fenomenico, cioè non “sentono” nulla. I computer eseguono istruzioni senza alcuna volontà o consapevolezza; non sono, in altre parole, in grado di leggere il significato dei simboli. Ma se la coscienza produce conoscenza ed è, quindi, utile nelle decisioni, i computer non possono sostituire l’intelligenza umana che si avvale della coscienza per leggere e comprendere la realtà[5].

La coscienza organizzativa ha, quindi, un ruolo perché dovrebbe guidare anzitutto le banche verso scelte che non danneggino gli individui e le comunità; senza una coscienza etica e morale, possono verificarsi pratiche predatorie, tassi usurai o investimenti in attività speculative e rischiose. Nella grande crisi finanziaria del 2007-2008, l’azzardo morale ha prevalso sull’etica di banchieri dimostratisi socialmente irresponsabili.

Pertanto, quando parliamo di coscienza, l’immagine più immediata è quella del banchiere attento ai problemi della sostenibilità, al principio dell’equità per cui la massimizzazione del profitto, derivante dall’attività creditizia, dovrebbe conciliarsi con effetti benefici per tutti gli stakeholder, per l’economia e i territori in cui la banca opera, a favore del bene comune.

Ma la coscienza ha un ruolo anche per il “banchiere razionale”. La coscienza è uno strumento di apprendimento e una guida nel prendere le decisioni nel modo più consapevole e razionale. Infatti, la coscienza produce conoscenza del reale attraverso le sensazioni, le emozioni, i sentimenti, come compassione, paura, fiducia. Basti pensare a come il personale di una banca possa apprendere immediatamente i cambiamenti di “umore” del mercato, prima ancora che arrivino i dati statistici sulla scrivania del management. Queste informazioni qualitative con difficoltà sono processabili e un computer che interagisce con la clientela non è in grado di auto-rendersi conto del significato implicito che esse hanno.

Coscienze vigili: gli algoritmi possono sbagliare

Se i sistemi di IA hanno dei limiti, la coscienza, con le sue capacità che abbiamo indicato, serve al banchiere che non si fida (o non si fida totalmente) dell’IA. Essere consapevoli della propria azione significa saperne anche valutare le conseguenze e poter migliorare le decisioni future sulla base dei risultati dei comportamenti passati. Le emozionipossono, tuttavia, indurre all’impulsività riducendo la lucidità con cui le decisioni dovrebbero essere prese ma anche a disubbidire alle regole e generare comportamenti innovativi.

Vi è, quindi, una sorta di contrapposizione tra l’innovazione che può generare la libertà delle coscienze – grazie all’ immaginazione, all’ intuizione, alla creatività – e una condotta stabile e sicura derivante dal controllo dei comportamenti organizzativi quando le decisioni sono computerizzate e prese dalle macchine di cui le direzioni bancarie si fidano più delle persone, ritenendo, inoltre, che l’IA sia superiore alle capacità cognitive delle stesse persone.

Se l’aumento di automazione, nelle organizzazioni complesse, è una risposta al calo di fiducia, si ha, come abbiamo già osservato, un depotenziamento della “coscienza organizzativa” con le conseguenze già ricordate. Infatti, nei sistemi aziendali in cui prevalgono modelli decisionali basati sulle procedure standardizzate – a cui è affidata una serie di compiti automatizzati come valutazioni e controlli – si consolidano ulteriormente le culture burocratiche che demotivano e deresponsabilizzano.

Ne può derivare il rischio di sistemi aziendali che operano in situazione di scarsa consapevolezza del loro funzionamento per cui vi è la possibilità di improvvise variazioni di performance o di crisi senza la comprensione delle relative cause sulle quali intervenire. Quindi, è necessario che le “coscienze” siano sempre attive, e bisogna riattivarle se si disattivano, prestando attenzione ai sintomi di disengagement, demotivazione e de-responsabilizzazione.

L’importanza che, anche in contesti automatizzati, hanno le “coscienze vigili”, si dimostra allorquando è proprio dal personale scrupoloso, intellettualmente indipendente, che si hanno le condotte “disobbedienti” che evitano errori e anche disastri grazie alla loro intuizione che “qualcosa non quadra”, alla loro immaginazione nel ritenere che la soluzione non convince e che quella giusta potrebbe essere diversa. Ed è proprio allora che l’intelligenza umana, nella sua parte più sofisticata – la coscienza – si dimostra superiore.

Grazie alla consapevolezza che è propria dell’umano, risulta palese la differenza tra la realtà e l’ immagine della realtà. I computer apprendono immagini, parole, numeri ma non comprendono a quali persone o oggetti tali immagini, parole, numeri si riferiscono, Così, nella valutazione del rischio di credito, i computer possono raccogliere dati, informazioni, immagini, scritti ed elaborare automaticamente indici di sostenibilità e solidità ma non sono in grado di associare la visione contabile alla realtà fisica, tecnologica e umana delle imprese da valutare, a differenza della capacità percettiva di un valutatore umano che, grazie ai propri sensi, è in grado di passare dalle immagini all’ immaginazione della realtà sottostante che egli elabora grazie al proprie capacità intellettuali.

Si possono configurare, ad esempio, sistemi di IA con funzioni di diagnosi economico-finanziarie e di allocazione delle risorse, orientando le scelte degli impieghi del risparmio tenendo conto degli obiettivi della politica industriale del Paese, o dei criteri della sostenibilità ESG fissati dal regolatore, compatibilmente con gli equilibri gestionali aziendali. Resta, pur sempre decisivo, anche in questo caso, il fattore umano “con la propria preparazione culturale e spirituale e con la propria cosciente ed operante volontà” come si diceva più di mezzo secolo fa (un principio che i banchieri attuali stanno dimenticando) [6].

6. Dalla coscienza alle ragioni tecniche

Già Cicerone ammoniva sui possibili rischi derivanti dal rispetto inflessibile delle norme, riassumibili nel noto brocardo “Summum ius, summa iniuria”: a dispetto di quello che possa sembrare, il rispetto pedissequo delle regole non porta necessariamente a scelte migliori, ma spesso si traduce esso stesso in arbitrio, proprio perché non prende in debita considerazione l’insieme di elementi specifici che distinguono il singolo caso rispetto alla media.

La capacità di valutazione discrezionale, dunque, lungi dall’essere condizionata da idiosincrasie e viziata da “irrazionalità”, si caratterizza al contrario per rappresentare quella “giustizia del caso singolo”, spesso identificata con l’equità, che costituisce il criterio di decisione in base al quale il giudice adatta la norma giuridica alle particolarità concrete di una controversia.

Analoghe considerazioni si possono fare nel contesto finanziario, anch’esso all’apparenza ispirato al rispetto ferreo e inflessibile di regole tecniche “oggettive”, poste a presidio di garanzia di imparzialità, oltre che di efficienza.

I rischi di de-responsabilizzazione delle decisioni automatizzate

In realtà, l’adozione di meccanismi decisionali automatizzati rischia, da un lato, di de-responsabilizzare il decisore, che subisce la tentazione di essere “catturato” dalle decisioni algoritmiche, che sono nei fatti il frutto di scelte anonime (rectius: opache) effettuate sostanzialmente dai progettisti dei sistemi automatizzati, sulla base del loro sistema di valori di riferimento (sistema di valori che esiste comunque, a dispetto dei proclami di “neutralità”, e manifesta la propria influenza in maniera surrettizia, spesso occultata dietro l’alibi della tutela del “segreto industriale” dei produttori).

Dall’altro, si rischia di assumere decisioni che si rivelano sub-ottimali, se non addirittura “irrazionali”, proprio a causa dell’incapacità di tali sistemi automatizzati di valutare appieno gli effetti e le conseguenze negative dovute alla mancata considerazione di informazioni rilevanti, che per loro natura non sono traducibili in entità simboliche esplicite e formalmente definite, suscettibili di essere trattate computazionalmente.

Tra queste informazioni rilevanti vi rientra non soltanto quella che viene definita “conoscenza tacita e implicita” descritta da Polanyi, che riflette appunto il sistema di valori condivisi che contraddistingue una comunità sociale in un determinato periodo storico, ma anche quella “conoscenza dispersa”, descritta efficacemente da von Hayek come “conoscenza delle condizioni specifiche di stato e luogo”, che è appannaggio esclusivo dei singoli individui, perché è associata alle loro specifiche aspettative e aspirazioni.

L’irrazionalismo delle decisioni “ottime”

La pretesa, dunque, di riuscire a inferire tale conoscenza tacita e dispersa mediante l’addestramento di sistemi data-driven, tra i quali rientrano anche i modelli di machine learning (di cui anche l’attuale Generative AI è solo l’ultimo dei ritrovati), rischia di tradursi, nella migliore delle ipotesi, nella più classica delle “profezie che si auto-avverano”: poiché la scelta stessa dei dataset di addestramento ritenuti rilevanti è condotta sulla base di una specifica “visione del mondo”, anche i risultati estrapolati dalla macchina sulla base di tali dati sarà inevitabilmente affetta dai “vizi” (bias, errori sistematici, incoerenze, ecc.) che affliggono i dati di training selezionati.

Nella sua attività di ottimizzazione, la macchina (rectius: l’algoritmo) non decide “il campo di gioco”, né detta le regole da seguire, ma si limita a computare i risultati sulla base delle condizioni e degli obiettivi che vengono imposti dall’alto (tipicamente dal progettista). Troppo spesso si tende a trascurare questo particolare, attribuendo agli algoritmi delle prerogative che non sono loro proprie, come quella della supposta “obiettività” e “neutralità”, specie se comparata con l’asserita discrezionalità umana, da cui la macchina è reputata essere immune.

Verso Digital Bank coscienziose

Abbiamo bisogno di un modello di banca digitale che integri consapevolezza, responsabilità e intenzionalità nelle sue scelte tecnologiche e organizzative. Le Digital Bank coscienziose rappresentano una auspicabile generazione di banche che ripensano il proprio ruolo nella società. La loro cifra distintiva non è la tecnologia in sé, ma il modo in cui la tecnologia viene scelta, governata e resa trasparente. Le banche devono unire l’ innovazione tecnologica alla responsabilità per restare “ banche dal volto umano”. In tal modo, la banca conserva la propria coscienza organizzativa a presidio di valori etici e morali, grazie all’inclusione e alla partecipazione del personale ai processi decisionali.

Un management che persegua la massimizzazione del profitto dell’impresa ha bisogno di una coscienza organizzativa etico-morale. Questa dovrebbe entrare in azione proprio quando la tecnologia tende ad avere il sopravvento e a rafforzarsi sulla base della convinzione che l’attività creditizia debba rispondere a valutazioni strettamente “oggettive” e, quindi, computerizzate.

Ma l’IA non ha una coscienza e l’uso degli algoritmi nella concessione dei prestiti può generare possibili discriminazioni. I finanziamenti possono venire limitati o evitati nei confronti di dati segmenti di imprese e persone per effetto di parametri troppo restrittivi.

E ciò non solo per massimizzare i profitti ma anche per pregiudizi o considerazioni estranee al merito creditizio nei confronti di segmenti che i modelli di marketing automatizzati escludono dalle strategie di sviluppo. In effetti, se gli algoritmi sono progettati per contenere i rischi e massimizzare la creazione di valore per gli azionisti, l’erogazione del credito può entrare in contrasto con la responsabilità sociale. Le Digital Bank, tecnologicamente perfette, rischiano di diventare “banche senz’anima”?.

[1] Regia di P. Garinei e G. Landi, 1979.

[2] I qualia sono “portatrici di significato” (conoscenza semantica) delle sensazioni e dei sentimenti con cui la coscienza esperisce e trasforma l’informazione simbolica che viene dal mondo esterno conoscibile secondo i dettami della fisica classica, comprendendoli nel significato che viene dal profondo della persona. Vedi F. Faggin, Oltre l’invisibile. Dove scienza e spiritualità si uniscono, Mondadori, 2024. In tal senso, si distinguono dalla conoscenza simbolica espressa nei parametri della fisica classica. I qualia si suddividono in quattro classi: sensazioni e sentimenti fisici; emozioni; pensieri; sentimenti spirituali. Vedi F. Faggin, Irriducibile. La coscienza, la vita, i computer, la nostra natura, Mondadori, 2022.

[3] Cfr. C. Ghiringelli, R. Nacamulli, Luca Quaratino, Disordine organizzato, il Mulino, 2025.

[4] Vedi M. Baravelli, V. Pesic, La tecnologia sta cambiando il lavoro bancario? Sì, ma con effetti di demotivazione e impoverimento delle professionalità, Key4Biz,30 maggio 2025.

[5] Secondo Faggin, la coscienza coincide con ciò che tradizionalmente chiamiamo “anima”; la coscienza è primaria, non deriva dal cervello; non è un prodotto dell’attività neuronale, ma una realtà quantistica e non-locale, cioè non riducibile alla materia. È la fonte del significato e dell’esperienza soggettiva. Faggin sostiene che la coscienza e il libero arbitrio sono fenomeni puramente quantistici esistenti in una realtà più vasta di quella che gli strumenti e il corpo umano possono rilevare. Vedi F. Faggin, Oltre l’invisibile, cit.

[6] Vedi G. Dell’Amore, Le funzioni dei sistemi bancari nell’economia contemporanea, Giuffré, 1955.