Amato, odiato algoritmo: formula magica dei tempi moderni, è quello che ci suggerisce su Spotify una canzone che, in base ai nostri ascolti, potrebbe piacerci, che fa spuntare tra un post e l’altro su Instagram proprio il lampadario o le cuffie hi-tech che cerchiamo da un po’, che ci fa tornare in contatto con il collega che avevamo perso di vista. Ma allo stesso tempo è anche quella cosa in grado di sposare i risultati delle elezioni, come ha insegnato lo scandalo di Cambridge Analytica, e che con l’intelligenza artificiale dei deepfake permette ormai di creare filmati con protagonisti ignari, riprodotti tanto bene da essere indistinguibili anche per l’occhio esperto.

Gli algoritmi sono le strategie che possono stabilire il trionfo o la crisi della startup più promettente, e il bello è che molto raramente si può capire fin da subito quali saranno i migliori e più efficaci. Google fondò il suo impero sbaragliando tutti gli altri motori di ricerca ormai molti anni fa, grazie all’intuizione geniale (l’algoritmo PageRank, creatura di Larry Page) di classificare i siti in base alla loro affidabilità, definita dal numero di citazioni e link verso i siti stessi. Un cambio di prospettiva che ha cancellato in breve tempo chi ancora si affidava a sistemi più rozzi e tradizionali, come il numero di volte che la parola o l’espressione ricercata compariva in una determinata pagina, magari costruita apposta in questo modo per intercettare il traffico senza alcun valore aggiunto per l’utente.

L’algoritmo e la “formula magica” di TikTok

Per questo motivo, gli algoritmi sono la parte più succosa delle proprietà intellettuali digitali, custoditi gelosamente e brevettati per evitare brutte sorprese. Così, quando si sa qualcosa di più sugli algoritmi delle aziende di maggior successo è naturale che ci sia grande interesse, anche se alla fine il risultato spesso è deludente, visto che il segreto del successo è molto più complicato di una semplice sequenza di operazioni codificate.

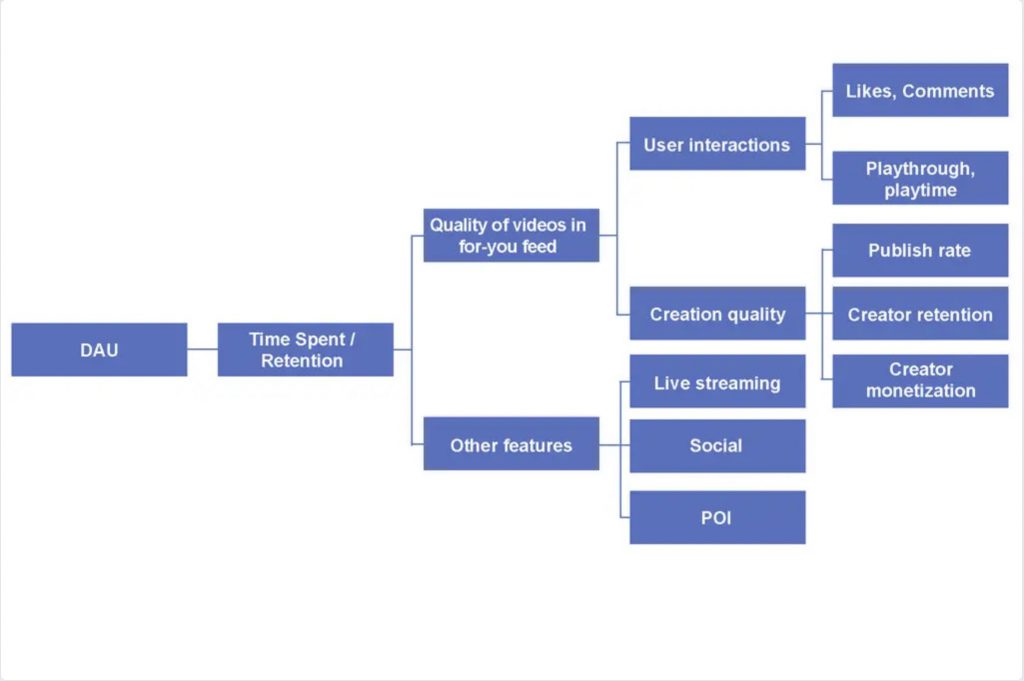

Ha fatto scalpore, pochi giorni fa, questa formula apparentemente incomprensibile, di cui è entrato in possesso il New York Times: Plike X Vlike + Pcomment X Vcomment + Eplaytime X Vplaytime + Pplay X Vplay. È l’algoritmo di TikTok, il social network cinese che continua a crescere inarrestabile tra i giovanissimi e non solo, e che dovrebbe fare luce su come l’azienda propone ai suoi utenti contenuti di potenziale interesse.

TikTok, infatti, è noto per il suo particolare “effetto nassa”: è facile entrarci ma molto più difficile uscirci, e se i primi video proposti possono non risultare particolarmente interessanti, man mano che si persevera le scelte si fanno più mirate, raffinate, e diventa davvero complicato staccarsi da queste sequenze brevissime e addictive.

In realtà, quasi tutti si sono detti piuttosto delusi da questo scoop che, in fin dei conti, non è stato particolarmente sorprendente: gli elementi della formula sono infatti i like, i commenti, il tempo di visualizzazione e così via, fattori assai prevedibili, al di là del titolo un po’ acchiappaclick del Ny Times (“Come fa TikTok a leggere la tua mente”). Ma questo non vuol dire che non ci siano dettagli interessanti.

Come sfidare la noia con le ripetizioni

Il documento, inviato al quotidiano statunitense da una fonte anonima, era destinato agli ingegneri informatici di un evento organizzato dalla stessa piattaforma, TikTok Algo 100. I due valori più importanti sono la retention (presente se un utente torna a utilizzare l’applicazione dopo la prima volta) e il time spent, il tempo trascorso sul social network, che aumenta anche in relazione alle offerte sempre più convenienti per Internet mobile oggi disponibili (su SOSTariffe.it si possono comparare quelle di maggior interesse oggi in Italia). Detto in parole più semplici, ciò che l’applicazione vuole è che l’utente passi più tempo possibile su di essa. Un problema rilevante, però, è la noia: da una parte, proporre contenuti molto simili a quelli che sono già stati apprezzati dall’utente significa che con buona probabilità apprezzerà anche quelli suggeriti; dall’altra, vedere sempre la stessa cosa, con poche varianti, rischia di stufare in fretta. Ed è notevole constatare come la fonte che ha passato il documento al New York Times l’abbia fatto perché a suo dire turbata dal tentativo di TikTok di suggerire contenuti “tristi”, che possono potenzialmente portare alla depressione. In ogni caso anche lo stesso giornale ha dovuto concludere che «non c’è niente di inerentemente sinistro o incomprensibile riguardo all’algoritmo di raccomandazione di TikTok come descritto nel documento».

Clearview Ai e un “motore di ricerca delle facce” non troppo preciso

Ma gli algoritmi possono essere sinistri, eccome. Ne è un esempio Clearview Ai, ormai la più contestata tra le società di riconoscimento facciale, che ha appena avuto il via libera, tramite un avviso di concessione, per ottenere il brevetto dal governo dagli Stati Uniti, stando a quanto ha rivelato Politico. Ma come funziona l’algoritmo di Clearview Ai, e perché è così criticato? Perché utilizza, con poco o nessun riguardo per la privacy degli utenti, milioni di fotografie recuperate attraverso un web crawler dai social media e dal web, raffiguranti persone che a loro insaputa possono finire nei database dell’azienda americana.

Ma il problema non riguarda solo la preoccupazione, tutt’altro che da sottovalutare, di venire schedati con le proprie fattezze senza avere dato il proprio consenso. I rischi sono molto più alti, considerato che, a quanto pare, l’algoritmo di Clearview Ai non funziona così bene quando si tratta di riconoscere i volti delle donne e delle persone di colore; se venisse usato ad esempio per aiutare nelle indagini per un crimine identificando i sospetti (e l’anno scorso è stato fatto proprio così da più di 2.400 agenzie di polizia, tra cui l’FBI e il Dipartimento della Sicurezza degli Stati Uniti, come ha mostrato un’inchiesta di Buzzfeed), potrebbe portare a un pregiudizio verso queste categorie, favorendo falsi arresti e andando a gettare benzina sul fuoco nel rapporto già tesissimo con la minoranze. Il “motore di ricerca delle facce”, proprio per il suo modello di business che si rivolge esclusivamente a clienti governativi, rischia così di mostrare tutto il volto più inquietante dell’algoritmo.