Meta corre ai ripari (mentre è sul banco degli imputati negli USA): se un minore ricerca contenuti pericolosi su Instagram scatta l’avviso ai genitori

A fine gennaio, presso la Corte Superiore di Los Angeles, ha preso il via un processo storico portato avanti dal Social Media Victims Law Center, in rappresentanza di 1.600 querelanti, 350 famiglie e 250 distretti scolastici, contro alcune delle più grandi e popolari piattaforme social al mondo, come Meta, Snap, TikTok e YouTube.

L’accusa alle Big Tech è progettare intenzionalmente servizi online per creare dipendenza. Una volta che i minori, ragazzini e adolescenti in particolare, entrano su queste piattaforme, sostengono le associazioni di genitori, cadono preda di depressione, disturbi alimentari, autolesionismo e altri problemi di salute mentale, fino, in alcuni tragici casi, al suicidio.

Proteggere i minori dai rischi dei social network è diventata una priorità politica in mezzo mondo. L’Australia ha vietato l’accesso ai social agli under 16. In Francia è in discussione un divieto sotto i 15 anni. In Italia sono state depositate proposte simili. Nel frattempo, le piattaforme provano a correre ai ripari con nuove misure di tutela.

La vera novità in questo momento arriva proprio da Meta, che è tra i principali attori sul banco degli imputati. Instagram introdurrà un sistema di notifiche ai genitori: quando un adolescente cerca ripetutamente termini legati a suicidio o autolesionismo scatta l’alert. È la prima volta che una piattaforma sociale decide di avvisare in modo proattivo le famiglie e non solo di bloccare i contenuti o mostrare numeri utili di supporto.

Ma come funziona davvero questo sistema? E quali sono i rischi?

Come funziona il servizio di allerta per le famiglie

La novità riguarda gli account inseriti nel programma “Teen Accounts”, cioè i profili per adolescenti con strumenti di supervisione attivati dai genitori.

Il meccanismo è questo:

- Instagram analizza i modelli di ricerca degli utenti;

- se un adolescente effettua ricerche ripetute in un breve lasso di tempo su termini collegati a suicidio o autolesionismo, scatta un alert;

- la notifica non parte al primo tentativo, ma solo dopo ricerche reiterate: una scelta che, secondo Meta, serve a evitare eccessi di controllo e a “bilanciare tutela e autonomia”;

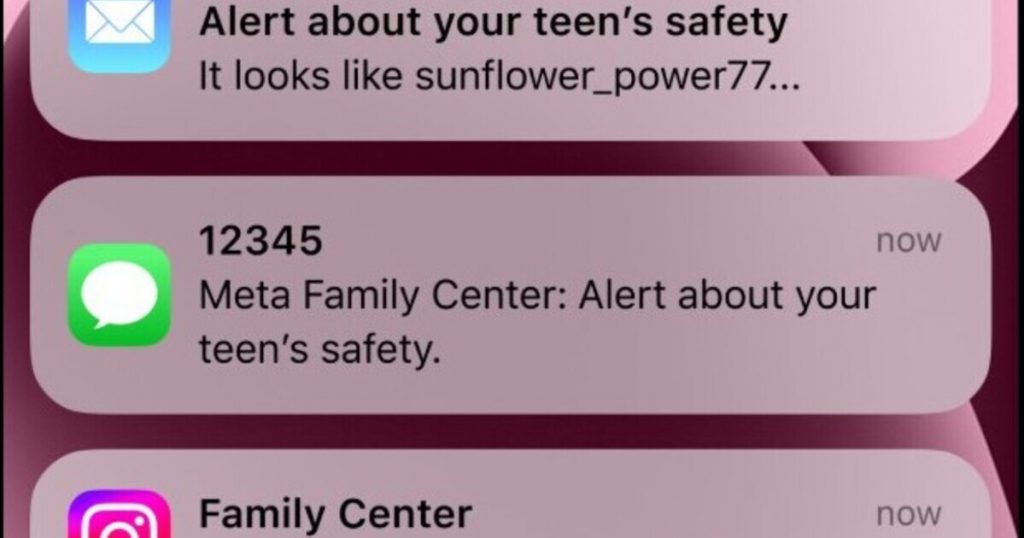

L’avviso viene inviato ai genitori attraverso email, SMS, WhatsApp e una notifica diretta nell’app. Insomma, tutti i canali possibili per rendere l’allerta efficace e tempestiva (perché non una telefonata?)

Aprendo il messaggio, il genitore accede a una sezione dedicata con linee guida e risorse elaborate con esperti, per affrontare in modo corretto una possibile situazione di disagio.

Meta ha dichiarato che il sistema, però, potrebbe anche sbagliare “per eccesso di cautela”, cioè significa che potranno arrivare notifiche anche in assenza di un reale pericolo. L’obiettivo dichiarato è intercettare segnali di sofferenza prima che sia troppo tardi. Prevenire è meglio che curare.

Dove è attivo il servizio e quando arriverà in Italia

La funzione entrerà in vigore a partire dalla prossima settimana per gli utenti iscritti ai Teen Accounts negli Stati Uniti, nel Regno Unito, in Australia e Canada.

Meta ha annunciato che l’estensione al resto del mondo avverrà entro l’anno, includendo anche l’Italia.

Dunque, salvo cambiamenti, il sistema di alert dovrebbe arrivare anche nel nostro Paese nei prossimi mesi.

A chi si rivolge

Il sistema è rivolto esclusivamente:

- agli adolescenti con account supervisionato;

- ai genitori che hanno attivato gli strumenti di controllo.

Non si tratta quindi di un monitoraggio generalizzato, ma di una funzione legata alla scelta della famiglia di aderire al sistema di supervisione.

Nei prossimi mesi, Meta prevede di estendere un meccanismo simile anche alle conversazioni con Meta AI, il chatbot dell’azienda: se un adolescente tenterà di avviare dialoghi legati a suicidio o autolesionismo, i genitori potrebbero ricevere un alert analogo.

Le piattaforme stanno facendo abbastanza?

Il dibattito internazionale mostra una tendenza chiara: i governi stanno valutando restrizioni drastiche, come il divieto di accesso sotto una certa età. Le piattaforme, dal canto loro, stanno introducendo strumenti di controllo parentale sempre più sofisticati.

Ma la questione di fondo rimane: la sicurezza dei minori può essere affidata solo ai genitori e a notifiche automatiche?

Molti esperti sostengono che serva un cambio di paradigma, si deve andare nella direzione di piattaforme progettate “by design” per essere sicure per i più giovani, con algoritmi che non spingano verso contenuti estremi e con sistemi di verifica dell’età realmente efficaci.

La vera prevenzione, alla fine, passa dalla fiducia, dall’ascolto e dalla capacità degli adulti di parlare apertamente di disagio, salute mentale e vita digitale. Le tecnologie possono aiutare a intercettare segnali, ma non possono sostituire la relazione.

In un’epoca in cui l’online è parte integrante della crescita, proteggere i più giovani è una responsabilità collettiva: delle famiglie, delle scuole, dei governi e delle imprese, che non possono e non devono mai mettere i profitti prima dell’essere umano, specialmente se parliamo di minori.