Rubrica settimanale SosTech, frutto della collaborazione tra Key4biz e SosTariffe. Per consultare gli articoli precedenti, clicca qui..

Dovremmo esserci abituati, ormai: è da decenni nella Silicon Valley domina incontrastato il superlativo. Tutto è ultra, mega, iper, ogni prodotto è groundbreaking, ogni nuovo modello è “il migliore mai realizzato” (e ci mancherebbe altro, no?). Però non impariamo mai, e non siamo stati scettici quanto avremmo dovuto nel sentire le roboanti dichiarazioni dei vari e imberbi plutocrati (ormai il modello è quello: fino a sei mesi prima brillante laureando, poi di colpo valutato vari fantastiliardi e pronto ad acquistare una luna di Saturno).

L’AGI, Artificial General Intelligence, il momento in cui l’AI avrebbe superato le capacità intellettive umane, era alle porte.

Tutto sarebbe cambiato, il mondo del lavoro rivoluzionato, anzi, forse non avrebbe più lavorato nessuno, grazie a un diffuso benessere regalatoci da un’obbediente intelligenza artificiale.

E invece salta fuori che, ecco, la quinta versione di ChatGPT non è rivoluzionaria come si pensava, in tanti preferivano l’iterazione precedente, e insomma il progresso clamoroso che c’era stato tra il modello 2 e il 3, e poi il 3 e il 4, non si è ripetuto; e lo stesso Sam Altman ha ammesso che sì, l’AI è, almeno parzialmente, un grande bolla, e solo una frazione delle aziende che adesso raccolgono investimenti sufficienti per risanare il bilancio di una piccola nazione produce qualcosa in grado di rendere davvero.

Nella vita quotidiana siamo abituati a ragionare in modo più sobrio: quando dobbiamo scegliere un piano di telefonia mobile o la fibra di casa, usiamo comparatori come SOSTariffe.it, guardiamo i numeri, confrontiamo i costi e decidiamo con i piedi per terra. Nel mondo dell’AI, invece, sembra che basti ascoltare le promesse dei CEO, senza la stessa dose di pragmatismo.

Problemi di memoria

What if A.I. doesn’t get much better than this? si è chiesto sul New Yorker di agosto Cal Newport, raccogliendo i pareri di chi dubita che le «neural scaling law», che proiettano crescite esponenziali per le reti neurali, siano qualcosa di più di una rilevazione empirica (e molto ottimistica). E, a dire il vero, diverse aziende hanno cominciato ad ammettere che, sì, l’AI ha cambiato il modo di lavorare in molti modi, ma a livello strumentale e non sempre strutturato, più come farebbe un’avanzatissima versione di un motore di ricerca che un’entità astratta da film di fantascienza di serie B.

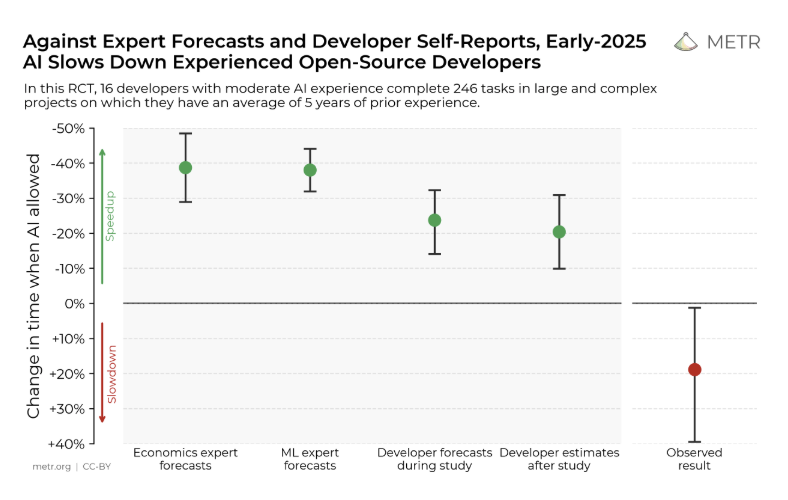

E in molti sono corsi ai ripari, virando verso le cosiddette post-training improvements (tecniche di raffinamento successivo, come reinforcement learning e ottimizzazioni specifiche), che migliorano i modelli già addestrati ma non creano salti radicali. Per gli scettici, l’AI del futuro sarà utile per compiti specifici (programmazione, scrittura, automazione di attività ripetitive), ma non trasformerà radicalmente la società né sostituirà la maggior parte dei lavori. Alcuni benchmark mostrano miglioramenti (soprattutto nel coding), ma ricerche indipendenti rivelano che i modelli cosiddetti “di ragionamento” collassano appena i problemi si fanno più complessi.

In più, una delle caratteristiche chiave della nuova AI, spesso sbandierata prima del tempo, è la sua capacità di memorizzare e adattarsi alle richieste dell’utente: ma in sempre più casi si riscontra che questa memoria è poco superiore a quella di un pesce rosso, dopo qualche prompt si ricomincia da capo, e anche il processo di addestramento dei modelli per le proprie esigenze rischia di dover essere ripetuto molte volte. Non proprio un risparmio di tempo.

AI: cominciano a mancare i dati

C’è poi un’altra questione: i dati da utilizzare per l’addestramento, prima o poi, finiscono. Puoi «nutrire» un modello con tutta Internet, ma dopo? Sundar Pichai, il CEO di Google, ha dichiarato che molti dei progressi più facili da raggiungere ora sono di fatto esauriti; il settore deve affrontare una salita più ripida per trovare nuove fonti e tipologie di dati e sviluppare algoritmi capaci di un vero salto qualitativo. Anche Epoch AI riporta che, per i modelli basati sul ragionamento, la spinta innovativa rischia di esaurirsi non solo per i limiti dei dati e delle GPU, ma anche per la sostenibilità economica e ambientale dell’intero processo di sviluppo.

Come sappiamo, la costruzione di AI avanzata comporta oggi costi energetici e finanziari crescenti: addestrare un modello all’avanguardia può consumare energia equivalente a migliaia di abitazioni per settimane. Non sono solo le GPU il problema, ma la capacità di gestire la ricerca avanzata, una voce che minaccia la scalabilità e rischia di concentrare ancora di più l’innovazione tra pochi colossi.

E se prima in pochi avevano dubbi che ne valesse la pena, di fronte a quelli che sembrano sempre più aggiornamenti incrementali, versioni potenziate di quanto è già disponibile, ora i dilemmi etici si fanno più pressanti.

In altre parole, il settore dell’AI potrebbe trovarsi all’inizio di una fase di maturità; la pressione sulle aziende per rendere l’AI più davvero intelligente e meno dipendente dai big data, nonché più sicura, sarà il tema dominante dei prossimi anni.

E allora, se davvero l’AI stesse rallentando, potremmo trovarci davanti a una di quelle rare inversioni di prospettiva che la Silicon Valley non ama mai raccontare. Non più l’epopea lineare, raccontata con toni tonitruanti dai nuovi megaricchi, della crescita senza fine, ma una storia ben più comune: un ciclo tecnologico che raggiunge un plateau, si assesta, smette di promettere miracoli e inizia a fare i conti con la realtà.

Perché dietro la retorica della superintelligenza, i fogli Excel degli investitori cominciano a presentare numeri che non tornano: decine e decine di miliardi bruciati in infrastrutture, GPU e server farm che divorano energia come piccole centrali elettriche, mentre i ricavi reali, quelli che dovrebbero sostenere questo castello di aspettative, restano sorprendentemente modesti.

Addio alla rivoluzione antropologica?

In questo scenario, l’AI si rivela per ciò che è per molti (forse per tutti?): un correttore automatico di nuova generazione, un assistente diligente che può velocizzare compiti noiosi, un generatore di codice che riduce i tempi di sviluppo. Nulla di cui vergognarsi, anzi. Ma molto distante dalle promesse di una rivoluzione antropologica. E, paradossalmente, riconoscere questi limiti potrebbe essere salutare: significherebbe liberarsi dalla retorica messianica e iniziare a discutere sul serio di regolamentazione, privacy, sostenibilità, impatti occupazionali.

Ci eravamo convinti che l’AI dovesse essere per forza “la prossima Internet”, “la prossima elettricità”. Ma non tutte le tecnologie hanno il destino di ridisegnare il mondo: alcune restano strumenti verticali, di grande valore economico e scientifico, senza per questo diventare il centro dell’universo.

Forse il vero compito, oggi, è abbassare il volume dell’hype e alzare quello della responsabilità. Se davvero ci troviamo in una fase di stanca, allora l’AI non ci sta regalando il futuro, ma ci sta restituendo tempo. Tempo per scrivere regole chiare, tempo per capire come usarla senza sprecarla, tempo per costruire una cultura digitale che non confonda le celebrazioni da conferenza stampa con i fatti. Sarebbe già un progresso.